AIの回答精度は、読み込ませる「ソース」で決まる。

最近、GoogleのNotebookLMやChatGPTのDeep Research機能など、特定のURLや資料をAIに読み込ませてから質問する使い方が主流になってきましたよね。

でも、いざ実践しようとすると、こんな「壁」にぶつかりませんか? 「読み込ませたいURLを一つずつ集めるのが、死ぬほど面倒くさい……」

特定のブログの全記事や、公式マニュアルの特定カテゴリーだけをAIに学習させたい時、ページを開いてはURLをコピペして……という作業を繰り返すのは、もはや「修行」に近い苦行です。

「もっと楽なWebサイトのURL抽出方法はないの?」 「効率的なサイト内のURLを抽出するツールが知りたい」

そんな悩みをお持ちの方へ。今回は、プログラミングの知識がなくてもコピペだけで使える、WebサイトのURLを一括抽出するやり方を詳しく解説します。

一瞬でURLリストを作成できる自作のブックマークレット(無料ツール)の紹介はもちろん、抽出したURLをAIに読み込ませる際の「私なりの最適解」まで、まるごと公開します。

結論から言うと、ブックマークレットが一番ラク

URL抽出ツールって、海外のよくわからないサイトとか、設定が面倒なChrome拡張機能とか、いろいろあるんですけど、セキュリティと手軽さを考えたら、ブックマークレットが最強だと思います。

「自作」って聞くと難しそうに感じるかもしれませんが、安心してください。私が用意したコードをコピペするだけで、30秒で完成します。

3ステップで「URL取得ボタン」を作る手順

まず、ブラウザにブックマークバーを表示させます。

- Windows:

Ctrl+Shift+B - Mac:

Command+Shift+B

ブックマークバーの空いている場所で「右クリック」→「ページを追加」を選択。

設定画面が開くので、以下のように入力して保存してください。

名前:URL抽出(わかりやすい名前でOK)

URL:以下のコードをすべてコピーして貼り付けてください

※もともと入っている https:// は消してください。

Chromeのバージョンによっては、ブックマーク作成時にjavascript:から始まるコードを貼り付けても、セキュリティ対策で先頭の「javascript:」という文字だけ勝手に消されることがあります。 もしボタンを押しても反応しない場合は、「ブックマークの編集」を開いて、先頭に javascript: がちゃんとついているか確認してみてください。

javascript:(async function(){const p=['/sitemap.xml','/sitemap_index.xml','/wp-sitemap.xml'];const d=window.location.origin;const n=document.createElement('div');n.style='position:fixed;top:20px;right:20px;z-index:100000;background:#333;color:#fff;padding:15px;border-radius:8px;font-family:sans-serif;';n.innerText='🔍 探索中...';document.body.appendChild(n);const g=async(u)=>{try{const r=await fetch(u);if(!r.ok)return[];const t=await r.text();const m=t.match(/<loc>(.*?)<\/loc>/g);return m?m.map(k=>k.replace(/<\/?loc>/g,'').replace('<![CDATA[','').replace(']]>','').trim()):[]}catch(e){return[]}};let s='';for(const f of p){const r=await fetch(d+f,{method:'HEAD'});if(r.ok){s=d+f;break}}if(!s){n.innerText='❌ サイトマップなし';setTimeout(()=>n.remove(),3000);return}n.innerText='📂 解析中...';let a=await g(s);let f=[];let x=a.filter(u=>u.endsWith('.xml'));let c=a.filter(u=>!u.endsWith('.xml'));if(x.length>0){const r=await Promise.all(x.map(u=>g(u)));f=c.concat(r.flat())}else{f=c}n.remove();const l=[...new Set(f)].sort();if(l.length>0){const b=document.createElement('div');b.style='position:fixed;top:5%;left:5%;width:90%;height:90%;z-index:99999;background:white;padding:20px;border:5px solid #00c853;display:flex;flex-direction:column;';b.innerHTML=`<h3 style="color:#00c853;">🎉 抽出完了 (${l.length}件)</h3><textarea id="cA" style="flex:1;width:100%;font-family:monospace;padding:10px;">${l.join('\n')}</textarea><button onclick="this.parentElement.remove()" style="margin-top:10px;padding:10px;cursor:pointer;">× 閉じる</button>`;document.body.appendChild(b);document.getElementById('cA').select()}else{alert('URLなし')}})();ネット上のコードをブラウザに登録するのは怖いですよね。

このブックマークレットは、以下の理由から100%安全です。

- 外部への送信は一切なし

-

このプログラムは、あなたのブラウザ内だけで完結します。取得したURLリストを、私のサーバーや第三者に送信する機能は一切入っていません。

- 見るのは「サイトマップ」だけ

-

このコードは、そのサイトが一般公開している「sitemap.xml」というファイルを見に行くだけです。あなたのパスワードや、閲覧履歴、会員情報(Cookie)などを読み取ることはありません。

- 動作は「表示」のみ

-

取得したURLを画面上に「四角い枠」で表示するだけの単純なプログラムです。勝手にクリックしたり、変なサイトへ飛ばしたりすることはありません。

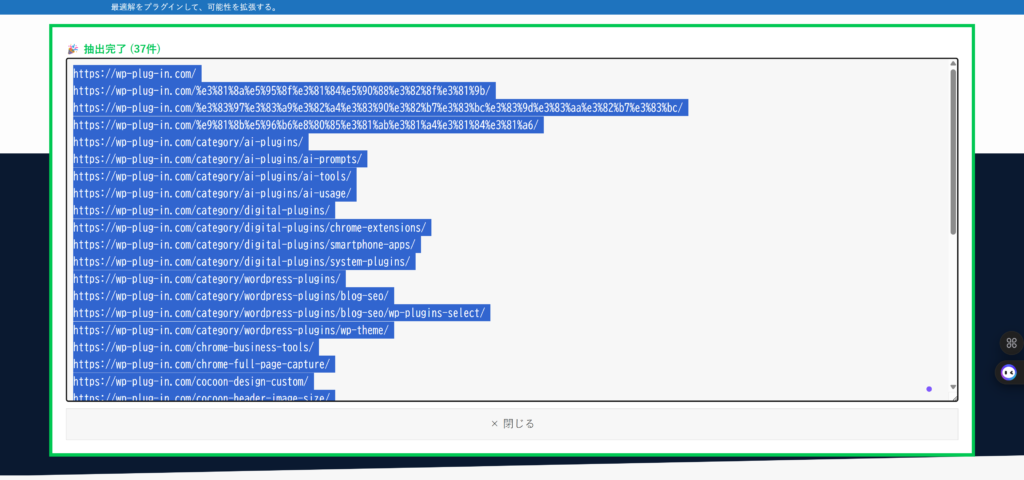

実際に使ってみた

使い方はシンプルです。

これだけで、検証サイトの全記事URLを一瞬でリスト化できました。

(※サイトマップ(sitemap.xml)が公開されているサイトでのみ機能します)

【重要】集めたURL、どう使いますか?

さて、ここからが本題です。 手元には信頼できる100個のURLリストがあります。これをどうやってAIに読ませますか?

- ChatGPT(無料版):一度に読み込める量に限界がある。

- NotebookLM:URLを一括で読み込ませた後に、ChatGPTやClaudeなどのほかのAIに回答を出力してほしい場合は、ソースをコピーし、貼り付ける手間がある。

私が検証した結果、Webブラウジングしながら、取得したURLリストを即座に「知識」として活用するなら、最強のツールはこれでした。

「Monica」なら、そのURLリストが即戦力になる

私が愛用しているAIアシスタント「Monica」には、取得したURLリストをそのまま放り込んで、自分専用の知識ベースを作れる機能があります。

NotebookLMのように「資料をまとめる場所」にわざわざ移動する必要はありません。 ブラウザのサイドバーにいるMonicaに、取得したURLリストを渡すだけで、「そのサイトの情報に基づいた、プロのアシスタント」がその場で爆誕します。

- 複数URLの一括読み込みに完全対応

- GPT-4oやClaude 3.5 Sonnetなど、最強モデルを選んで回答させられる

- ブラウザ拡張機能なので、作業を中断せずに使える

「URLを集めるツール」と「URLを最高効率で処理するAI」。 この2つ(プラグイン)を組み合わせるのが、今の私の最適解です。

なぜ私がそこまでMonicaを推すのか? 以下の記事で、その「神機能」の全貌を徹底的に検証・解説しています。AIで効率化を目指すなら、これを知らないと損です。

最強AIアシスタント「Monica」の徹底検証記事はこちら